Co to jest AI? Co warto o tym wiedzieć?

Sztuczna inteligencja to już nie przyszłość, a teraźniejszość. Odkryj, czym jest AI, jak działa i w jaki sposób rewolucjonizuje medycynę, technologię i życie codzienne.

Sztuczna inteligencja, znana szerzej jako AI (ang. Artificial Intelligence), to technologia, która rewolucjonizuje współczesny świat. Choć jeszcze kilka dekad temu była domeną literatury science fiction, dziś AI wpływa na gospodarkę, naukę, medycynę i codzienne życie. Czym dokładnie jest, jak działa i jakie niesie za sobą wyzwania?

Spis treści

Sztuczna inteligencja – definicja i działanie

AI to zdolność systemów komputerowych do wykonywania zadań, które normalnie wymagają ludzkiej inteligencji, takich jak rozpoznawanie wzorców, uczenie się, podejmowanie decyzji czy analiza danych. Najważniejszym mechanizmem napędzającym współczesną AI jest uczenie maszynowe (ang. Machine Learning), które umożliwia systemom automatyczne doskonalenie się na podstawie doświadczeń, zamiast opierać się na sztywno zaprogramowanych instrukcjach.

Wiele algorytmów AI bazuje na sieciach neuronowych, które są inspirowane strukturą ludzkiego mózgu. Dzięki temu systemy mogą analizować ogromne ilości danych w krótkim czasie, co pozwala im na wykrywanie wzorców i podejmowanie decyzji z dużą precyzją.

Poznaj kulisy sukcesu kampanii SEO w Kuchni Vikinga

wzrost przychodu z ruchu organicznego r/r +168%

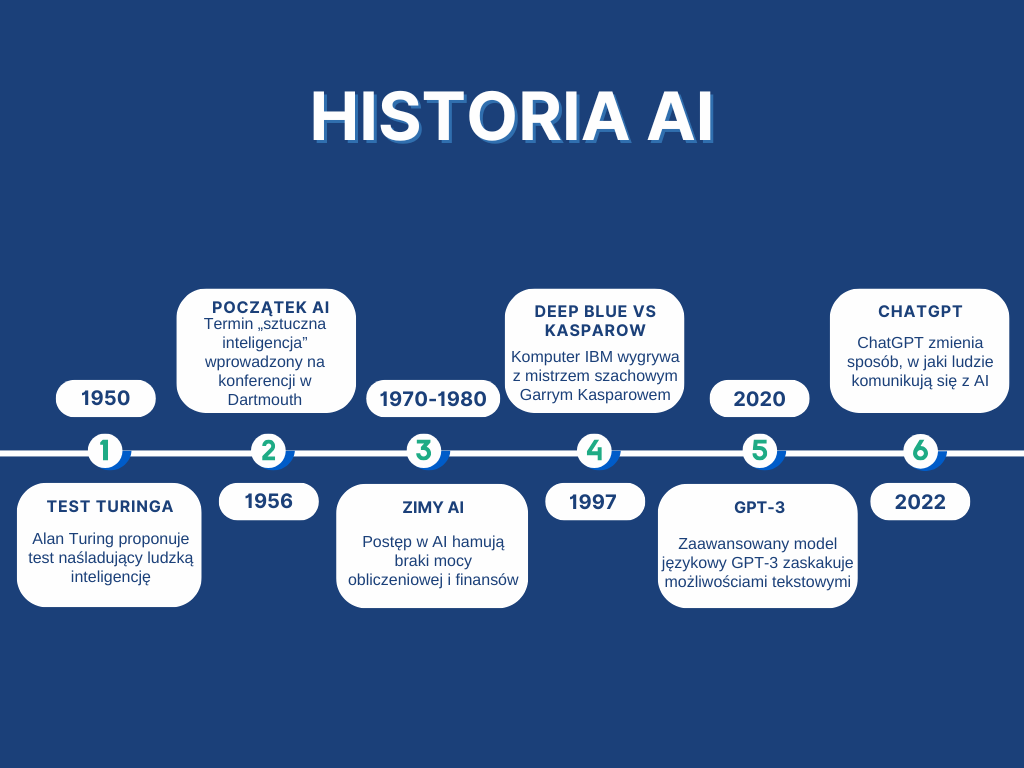

Krótka historia AI

Idea sztucznej inteligencji ma swoje korzenie w latach 50. XX wieku, kiedy Alan Turing zaproponował test oceniający zdolność maszyny do naśladowania ludzkiej inteligencji. W kolejnych dekadach rozwój AI przechodził różne fazy. W latach 70. i 80. pojawiły się tzw. „zimy AI”, kiedy brak mocy obliczeniowej i wysokie koszty badań spowolniły postępy w tej dziedzinie. Przełom nastąpił w XXI wieku, gdy rozwój szybkich procesorów, dostęp do ogromnych zbiorów danych i postępy w projektowaniu algorytmów umożliwiły wdrażanie AI w praktyce. To właśnie wtedy technologia ta zaczęła wychodzić poza laboratoria i trafiać do codziennego użytku.

Rodzaje AI – od prostych aplikacji do ambitnych wizji

Sztuczna inteligencja nie jest jednolita. Jej możliwości można podzielić na trzy główne kategorie:

- Słaba AI (Narrow AI): Jest to najczęściej spotykany rodzaj AI, zaprojektowany do wykonywania konkretnych zadań, takich jak rozpoznawanie obrazów, tłumaczenie języków czy rekomendacje produktów. Nie ma ona świadomości ani zdolności do adaptacji poza wąsko określony obszar.

- Silna AI (General AI): Wizja systemu, który mógłby dorównać ludzkiej inteligencji w rozwiązywaniu różnorodnych problemów. Chociaż prace nad General AI trwają, obecnie pozostaje ona w fazie teoretycznych badań.

- Superinteligencja: Hipotetyczny etap, w którym AI przewyższyłaby ludzkie zdolności intelektualne we wszystkich dziedzinach. Tego rodzaju wizje budzą nie tylko nadzieje, ale również obawy o potencjalne zagrożenia.

Jak AI wpływa na różne dziedziny życia?

Sztuczna inteligencja znajduje zastosowanie w wielu sektorach, często poprawiając efektywność i jakość procesów. Przykłady obejmują:

- Medycynę: AI analizuje zdjęcia diagnostyczne, wspiera wykrywanie chorób, takich jak nowotwory, i przyspiesza badania nad nowymi lekami. W wielu przypadkach algorytmy wykazują większą precyzję niż ludzie.

- Transport: Technologia AI umożliwia działanie samochodów autonomicznych, wspiera zarządzanie ruchem miejskim oraz optymalizuje trasy transportu publicznego.

- Finanse: Algorytmy pomagają w wykrywaniu oszustw, analizie ryzyka kredytowego oraz prognozowaniu trendów rynkowych, co czyni zarządzanie finansami bardziej efektywnym.

- Przemysł: AI zwiększa automatyzację w fabrykach, monitoruje procesy produkcyjne i przewiduje awarie maszyn, co zmniejsza koszty operacyjne.

- Rozrywkę: Systemy AI personalizują rekomendacje w serwisach streamingowych, generują treści, a nawet współtworzą filmy czy gry wideo.

Rola danych w rozwoju AI

Dane są fundamentem, na którym opiera się działanie sztucznej inteligencji. Im więcej danych jest dostępnych do trenowania algorytmów, tym bardziej zaawansowane modele można stworzyć. Na przykład systemy rozpoznawania mowy potrzebują tysięcy godzin nagrań dźwiękowych w różnych językach, aby nauczyć się dokładnego przetwarzania mowy. Jakość danych ma równie duże znaczenie, jak ich ilość. Jeśli dane są stronnicze, niepełne lub zawierają błędy, mogą prowadzić do niepożądanych rezultatów – np. nierównego traktowania różnych grup społecznych przez algorytmy.

Modele językowe i ich znaczenie w AI

Systemy językowe, takie jak GPT, reprezentują jeden z najbardziej zaawansowanych obszarów AI. Dzięki przetwarzaniu ogromnych zbiorów danych tekstowych modele te potrafią generować teksty, tłumaczyć języki czy odpowiadać na pytania w sposób zbliżony do ludzkiego. Ich działanie opiera się na przewidywaniu kolejnych słów w zdaniu na podstawie kontekstu, co czyni je wyjątkowo elastycznymi narzędziami. Modele językowe są trenowane na tekstach pochodzących z różnorodnych źródeł, takich jak książki, artykuły, strony internetowe czy dialogi. Im większy i bardziej zróżnicowany jest zbiór danych, tym lepiej modele radzą sobie z generowaniem odpowiedzi dostosowanych do różnorodnych tematów i stylów. To pozwala im być użytecznymi w tak różnych dziedzinach jak tworzenie treści marketingowych, automatyzacja obsługi klienta czy analiza sentymentu w mediach społecznościowych.

Mimo swojej imponującej skuteczności modele językowe mają swoje ograniczenia. Nie posiadają rzeczywistego zrozumienia świata ani intencji użytkownika. Ich odpowiedzi są wynikiem analizy statystycznych zależności między słowami, co może prowadzić do błędów w przypadku niejasnych lub wieloznacznych zapytań. Na przykład, gdy brakuje danych treningowych dotyczących konkretnego tematu, modele mogą generować informacje niepełne lub nieprecyzyjne. Co więcej, istnieje ryzyko, że modele odzwierciedlają uprzedzenia zawarte w danych treningowych. Jeśli teksty, na których były szkolone, zawierają błędne informacje lub stereotypy, modele mogą je nieświadomie reprodukować. Dlatego odpowiedzialne wykorzystywanie tych technologii wymaga nie tylko ich zaawansowanego projektowania, ale także ciągłego monitorowania i ulepszania.

Wyzwania związane z AI

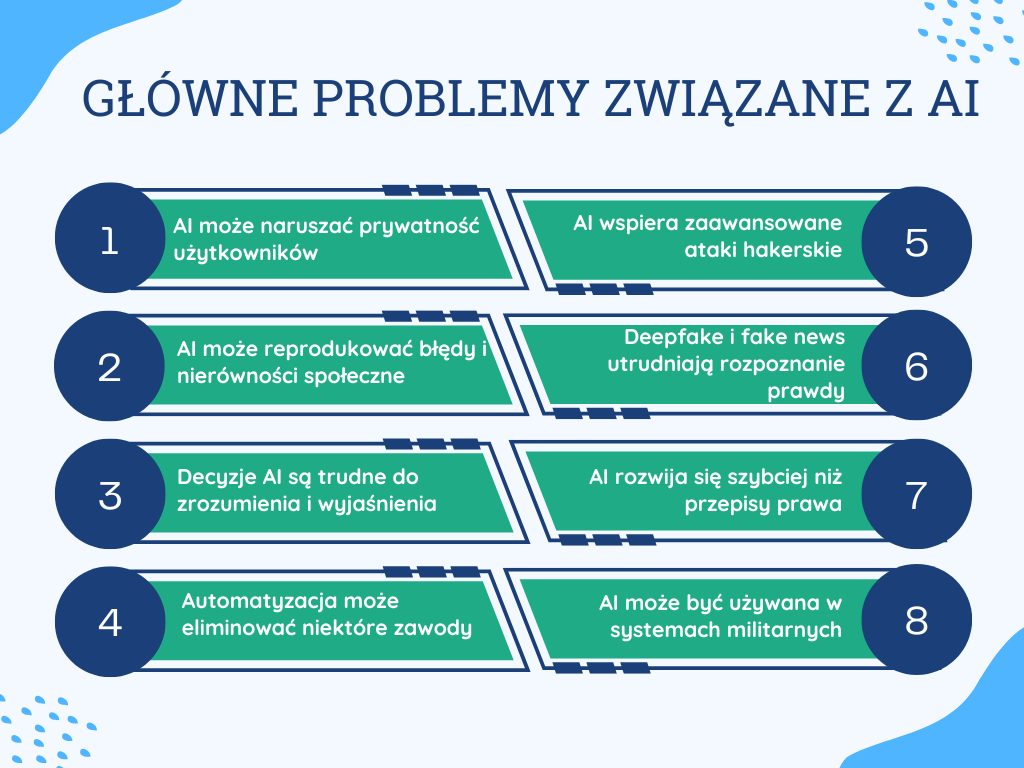

Rozwój sztucznej inteligencji niesie za sobą liczne wyzwania, które wykraczają poza kwestie techniczne. Obejmują one zarówno zagrożenia dla bezpieczeństwa, jak i fundamentalne pytania etyczne dotyczące granic wykorzystania tej technologii. Najważniejsze z nich to:

- Bezpieczeństwo: zaawansowane systemy AI mogą być wykorzystywane w celach nieetycznych, takich jak cyberataki, dezinformacja czy masowa inwigilacja. Wraz z rozwojem narzędzi generatywnych, jak deepfake, pojawia się także ryzyko tworzenia fałszywych treści, które mogą wprowadzać w błąd społeczeństwo na szeroką skalę.

- Prywatność: Analiza ogromnych ilości danych osobowych budzi pytania o granice ingerencji w życie ludzi. Zbieranie danych przez firmy technologiczne oraz ich wykorzystanie do trenowania modeli AI stawia wyzwanie ochronie prywatności jednostki, a często wiąże się z brakiem zgody użytkowników na takie działania.

- Uprzedzenia algorytmów: AI uczy się na podstawie danych, które mogą odzwierciedlać istniejące nierówności społeczne, co prowadzi do niezamierzonych dyskryminacji w decyzjach podejmowanych przez algorytmy. Przykłady obejmują nieobiektywne wyniki rekrutacyjne czy ograniczony dostęp do kredytów dla niektórych grup społecznych.

- Prawa autorskie: Systemy generatywne, takie jak te tworzące obrazy, teksty czy muzykę, budzą kontrowersje związane z własnością intelektualną. AI często korzysta z ogromnych baz danych, które obejmują dzieła chronione prawem autorskim, bez wyraźnej zgody ich twórców. Pojawia się pytanie, czy treści generowane przez AI są samodzielnymi dziełami, czy też powinny być traktowane jako transformacje istniejących materiałów. Wiele systemów nie daje możliwości sprawdzenia, na jakich danych zostały wytrenowane, co utrudnia ocenę, czy prawa autorskie zostały naruszone.

Jak odpowiedzieć na te wyzwania? Aby zminimalizować zagrożenia, niezbędna jest przejrzystość w działaniu systemów AI oraz stworzenie odpowiednich regulacji prawnych. Ważne są również inicjatywy mające na celu rozwój etycznych wytycznych, które określą, jak AI może być projektowana i wykorzystywana. W kontekście praw autorskich konieczne staje się wypracowanie zasad dotyczących wykorzystania danych treningowych oraz jasnego wskazania odpowiedzialności za generowane treści.

Kwestie te nie są jedynie problemem technologicznym, lecz wymagają globalnej współpracy między prawodawcami, naukowcami, a sektorem prywatnym, aby zapewnić, że rozwój AI przyniesie korzyści, nie naruszając jednocześnie praw jednostki ani twórców.

Czy AI zastąpi człowieka?

Chociaż AI w ostatnich latach osiąga imponujące rezultaty, nadal pozostaje narzędziem. Nie posiada ludzkiej intuicji, empatii ani kreatywności w pełnym tego słowa znaczeniu. Dlatego w wielu dziedzinach będzie raczej wspierać ludzi, niż ich zastępować. Przykładem mogą być zawody, w których istotne są umiejętności interpersonalne, takie jak nauczyciele czy lekarze.

Jednocześnie AI zmienia rynek pracy, automatyzując wiele powtarzalnych zadań. Wymusza to na pracownikach konieczność zdobywania nowych umiejętności, szczególnie w obszarach związanych z tworzeniem i zarządzaniem technologią.

Podsumowanie

AI to jedna z najbardziej fascynujących technologii XXI wieku. Jej zastosowania obejmują zarówno codzienne udogodnienia, jak i zaawansowane badania naukowe. Jednocześnie rozwój sztucznej inteligencji rodzi pytania o etykę, prywatność i bezpieczeństwo.

Choć AI już dziś zmienia świat, jej potencjał jest jeszcze większy, a przyszłość tej technologii zależy od odpowiedzialności i mądrości, z jaką zostanie wykorzystana.